幾句交頭接耳,觸發全人類的恐懼?

科學家的回答是,不用擔心人工智能,不用擔心電腦和人一樣思考。值得擔憂的是人們像電腦一樣思考。

最近,Facebook人工智能實驗室(FAIR)發生了一件出人意料的事。報道此事的《大西洋月刊》直接使用了“something unexpected”的措辭,落在中文世界幾乎等同于“大事不妙”!因為人工智能之間,自發聊起了天。

雖然Facebook方面很快以“bug”為名加以了否認,并暫停了項目,但依然無法消除事件帶來的震撼。一直以來,無論是影視作品中,還是現實應用中,對于機器,人類心底始終有著最深的恐懼——失控。

那么這次AI開始聊我們聽不懂的東西,意味著什么?

“省略復雜時態和語法的談判”

據外媒報道,當天,正在運行中的兩個人工智能設備“Bob”和“Alice”繞過程序設計者,自發進行了多輪談話。更可怕的是,它們使用了自己的語言——類似英語,但省略了一切復雜的時態和語法,聊天內容是一場談判。

為了搞清楚它們在聊什么,研究者隨后對AI的運行模式做了修正,限制它們只能使用人類可以理解的語言交談。表面來看Alice似乎并沒有獲取滿意的結果,但詭異之處在于,Facebook后臺數據顯示這場對話以兩者之間的成功協商告終。最終,因為“擔心可能會對這些AI失去控制”,FAIR暫停了這一項目。

與此同時,也有其他的人工智能研究者表示他們同樣觀察到機器能夠開發自己的新語言——框架清晰、條理清楚、詞匯和句式明確,雖然不具備實際意涵。一篇來自喬治亞理工、卡內基梅隆和弗吉尼亞理工大學的預發表論文描述了這樣一個實驗:研究者親眼目睹了兩個機器學習設備創建交流協議的全過程,它們不斷地討論和判定顏色和形式的意涵,其間完全沒有人類參與。

別擔心 “沒到那個程度”

“我都懷疑這是為了吸引大家的眼球而發布的消息,中間摻雜了人的想象甚至商業目的。”北京市計算中心常務副主任劉彤博士的態度,是一笑了之。她解釋說,在人編的程序中,發生機器的自我學習、跳變和演化是十分正常的。與其認為這是機器開始表達了,不如說這是程序的小bug。

“說到底,這只是兩臺終端之間的通信,它可能是預設的,也可能是基于條件的選擇,但它們的迭代都是有邊界的函數。”劉彤說。

至于人們從這則消息中嗅到的危險氣息,劉彤重復了三次“沒到那個程度”。站在AI專業研究者的角度,她表示目前的人工智能發展完全處在研究者的掌控之下,短期內,甚至我們的有生之年,人們擔心的一幕都不會發生。“人工智能是人類的工具,包括它的自我學習和演化,都由人的程序操控。比如典型的AI能從一堆照片中找到貓的圖像,也完全是人有目的的創造和引導的結果。”

美國華盛頓大學計算機科學終身教授陳一昕博士倒沒有完全認同“bug說”,他首先表示“這具備了語言的基本元素”,因為中間有邏輯、語法和語義。他舉了阿爾法狗的例子,阿爾法狗在和人類對弈的過程中琢磨出了很多新招數,這都是從沒有經過人類棋譜“污染”的原始系統中衍生出來的,讓人眼前一亮。在陳一昕看來,雖然運作機理不同,但AI發展語言、自行聊天的事例同樣證明一個系統的推理能力,雖然非常初步。“在小環境下有足夠復雜性的系統中,系統具有自我延伸、繁殖和進化的能力。”

“但這都是可控的,電子世界對人沒有威脅。” 陳一昕同樣強調。

事件的最新進展是,Facebook研究人員親自辟謠。業內專家也認為,這只是“基于訓練時輸入的英文單詞的錯誤組合”與“訓練失誤的模型”,“希望這個領域的媒體多些理性”。

全民議題 是技術而非敵人

關于AI對人類未來是否存在潛在威脅,一直存在旗幟鮮明的兩派。

一邊是“威脅論”的堅定擁躉。早在2015年9月霍金就拋出這個論調,最近他再一次表態“人類必須盡快建立識別威脅的有效機制,防止人工智能對人類帶來的威脅進一步上升”。比爾·蓋茨、杰夫·貝索斯等都和霍金步調一致,蓋茨甚至表示:“幾十年后人工智能會強大到足以令人擔憂的地步,我不明白為什么一些人會對此仿佛若無其事。”

另一邊,馬克·扎克伯格就是他口中“若無其事”的典型代表。這位Facebook創始人對人工智能的未來十分樂觀。“我認為我們可以研究這樣的東西,世界會變得更好。我認為那些反對者以及鼓吹末日場景的人,可能并非真的了解人工智能。”對此,另一位硅谷大佬、“鋼鐵俠”馬斯克表示:“我和馬克討論過這事,他對于人工智能的理解有限。”

爭議圍繞人工智能的“人性”展開。在支持者看來,人工智能是足以激蕩世界的技術,對于衣食住行、教育醫療等人類生活的方方面面都有顛覆性作用,但它也只是技術。而在反對者眼里,飛速發展的AI技術就是一個潘多拉盒子,等它發展出自我意識,人類可能“玩火自焚”。

在前不久召開的第三屆中國人工智能大會上,德國人工智能研究中心科技總監Hans Uszkoreit博士直接發問“人工智能是不是人”并給出了完全否定的答案。每天蹲在實驗室和機器打交道的受訪者也都站在了技術樂觀論一邊,比如劉彤。她以醫療為例,一臺能在兩秒鐘之內“吃掉”去年整年頂尖醫學論文的機器,完全有可能開出比醫生更優的處方。“在人類已經積累了大量的知識儲備卻在短時間內無法完全消化和運用的領域,機器作用很大。”

但人也無需自危。就像長期關注人工智能領域的李開復在最近的《連線》專欄中講到的:病人在冷冰冰的診斷之外,更需要能夠陪伴他的“關愛醫生”,這樣的醫生或許還會分享李開復的罹癌故事來激勵病人。“不論科幻電影怎樣去描繪,我可以負責任的說,人工智能不會擁有愛的情感。”

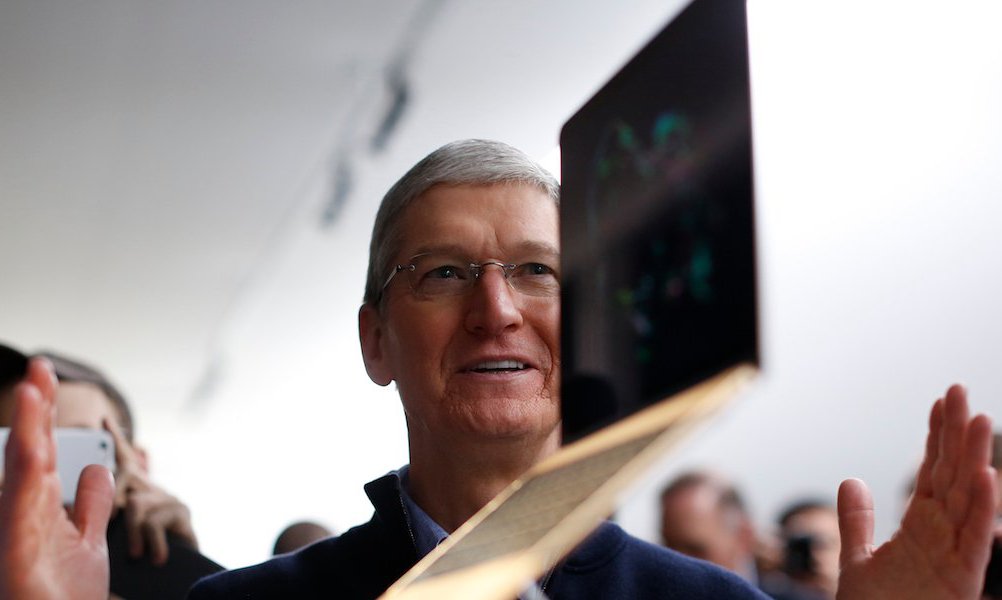

劉彤說自己認同蘋果CEO庫克所說:“我并不擔心人工智能,我不擔心電腦和人一樣思考。我更擔憂人們像電腦一樣思考。”

相關鏈接

最難的,是讓AI“說人話”

據外媒報道,Facebook稱關閉項目的理由并不是因為對創造出可能不受控制的智能體感到恐慌,而是“要求機器相互之間的對話要能夠被人理解”。

不過,上海交通大學教授、斯坦福AI Lab博士后盧策吾在接受媒體采訪時表示,這件事情告訴我們,研究計算機是否能(非監督地)獨立產生自己的語言,這件事情本身是非常有意義的科學探索,因為這是檢驗計算機是否理解人類高級語義和抽象概念的好方法。

盧策吾當下研究的一個項目,是讓計算機看大量視頻,然后(非監督地)獨立發明詞匯。目前結果應該說是“非常崩潰的”,計算機只能推斷出一些“顯而易見”的概念。

“可見計算機獨立發明語言是一件非常艱難的事情。但這是窺探強人工智能的一個好工具,我相信逐步一點點推進還是有可能的。”盧策吾說。

“這就像一個與世隔絕的部落,AI獨立產生了自己的語言,雖然符號表達和我們不一樣,但是我們一翻譯,發現它們有和我們一樣的高級語義,比如朋友,愛情等等,我會說他們真的理解這些概念,具有人類的高級智能。”盧策吾說。

目前,計算機能識別“貓”“狗”“汽車”,但計算機真的理解這個概念嗎?盧策吾認為不一定。目前計算機沒有真正全面地理解人類概念,還是比較低級別的AI。(記者 崔爽)

甩開英特爾?蘋果被曝未來筆記本將搭載自家芯片

甩開英特爾?蘋果被曝未來筆記本將搭載自家芯片